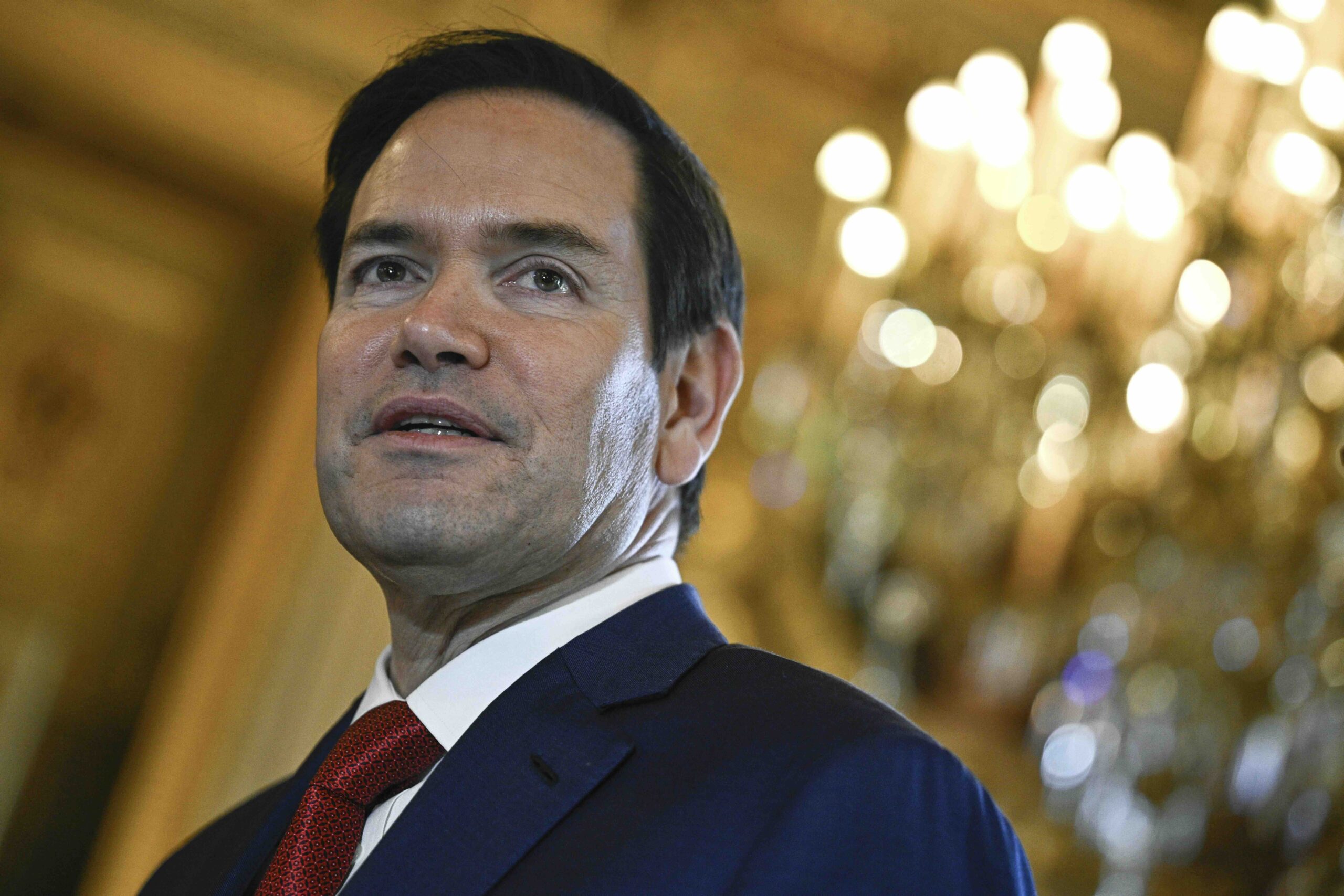

Troll versuchte, Außenminister mit KI-Marco Rubio zu kontaktieren

KI-Betrugsmaschen, bei denen gewählte Amtsträger imitiert werden, nehmen zu – und werden immer raffinierter. Das bekam auch Rubio zu spüren

Die Zeiten, in denen verifizierte Twitter-Nutzer ihre Namen änderten, um Prominente, Unternehmen oder Gesetzgeber zu imitieren – was zuvor mit einem dauerhaften Bann geahndet wurde – wirken wie ein harmloser Streich im Vergleich zu dem, was heute möglich ist. Jetzt, da die Werkzeuge unregulierter künstlicher Intelligenz in die Hände von Gelangweilten und Menschen mit böser Absicht gelangen.

Signal war bevorzugtes Kontaktmittel

Das Außenministerium macht diese Erfahrung nun auf die harte Tour. Laut einem Bericht der Washington Post vom Dienstag benutzte eine Person, die sich als Außenminister Marco Rubio ausgab, KI-Software, um Rubios Stimme und Schreibstil zu imitieren. Die noch nicht identifizierte Person kontaktierte mehrere Außenminister, ein Kongressmitglied und einen US-Gouverneur.

Die meisten der Kontaktversuche fanden über Signal statt. Die verschlüsselte Messaging-App, die politische Berühmtheit erlangte, nachdem der ehemalige nationale Sicherheitsberater des Weißen Hauses, Michael Waltz, versehentlich einen Journalisten zu einem Gruppenchat über Angriffspläne gegen den Jemen hinzufügte.

Laut einem am 3. Juli vom Post erhaltenen Kabel des Außenministeriums versuchte der Betrüger, mit den Amtsträgern Kontakt aufzunehmen. „Mit dem Ziel, Zugang zu Informationen oder Konten zu erlangen“. Die Person verwendete die gefälschte E-Mail-Adresse „Marco.Rubio@state.gov“ als Anzeigenamen. Und „hinterließ Sprachnachrichten auf Signal bei mindestens zwei Zielpersonen. Und verschickte in einem Fall eine Textnachricht mit der Einladung, über Signal zu kommunizieren“.

Weitere KI-Fälschungen im politischen Umfeld

Es ist nicht das erste Mal, dass KI dazu verwendet wurde, um öffentliche Amtsträger zu imitieren. Im Mai warnte das FBI vor einer „andauernden, böswilligen Text- und Sprachnachrichtenkampagne“. Bei der aufkommende Technologien eingesetzt wurden, um hochrangige US-Beamte zu imitieren. Ziel war es, „eine Vertrauensbasis zu schaffen, bevor Zugriff auf persönliche Konten erlangt werden sollte“.

Nach den Wahlen 2024 wurde ein politischer Berater wegen Wählerunterdrückung und Kandidaten-Imitation angeklagt, nachdem er mithilfe von KI ein Imitat der Stimme des ehemaligen Präsidenten Joe Biden erstellt hatte. Der Anruf entmutigte Wähler in New Hampshire, an der demokratischen Vorwahl des Bundesstaates teilzunehmen.

Im September letzten Jahres nahm der ehemalige Senator Ben Cardin an einem vermeintlichen Zoom-Anruf mit dem ehemaligen ukrainischen Diplomaten Dmytro Kuleba teil, den er zuvor kennengelernt hatte. Doch als er sich in das Gespräch einwählte, merkte Cardin schnell, dass die Person auf der anderen Seite der Leitung nicht echt war. Sondern ein Deepfake von Kuleba. Der versuchte, „politisch brisante Fragen im Zusammenhang mit der bevorstehenden Wahl“ zu stellen.

Noch keine diplomatische Katastrophe – aber bald?

In den USA hat es bislang keinen größeren diplomatischen oder politischen Skandal im Zusammenhang mit unentdeckten KI-Imitationen gegeben. Doch es fühlt sich mittlerweile an, als sei das nur noch eine Frage der Zeit.